YOLO v2深度解读

目录

YOLO9000: Better, Faster, Stronger

概况

YOLO9000: Better, Faster, Stronger

CVPR 2017

Better

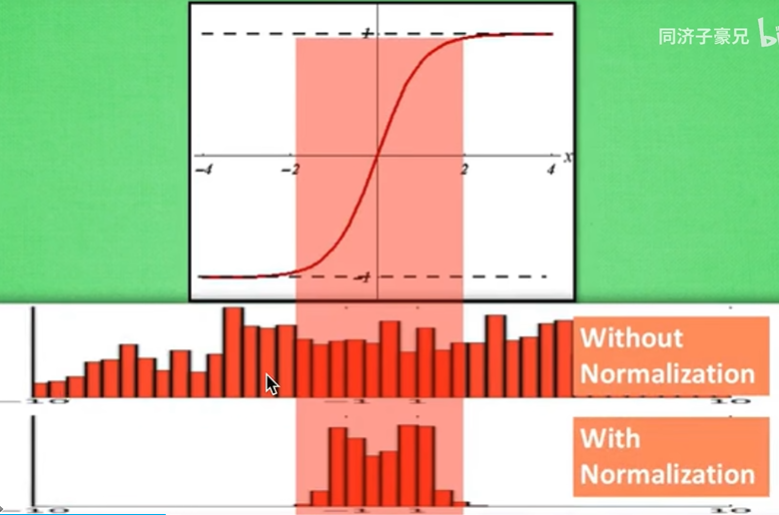

Batch Normalization

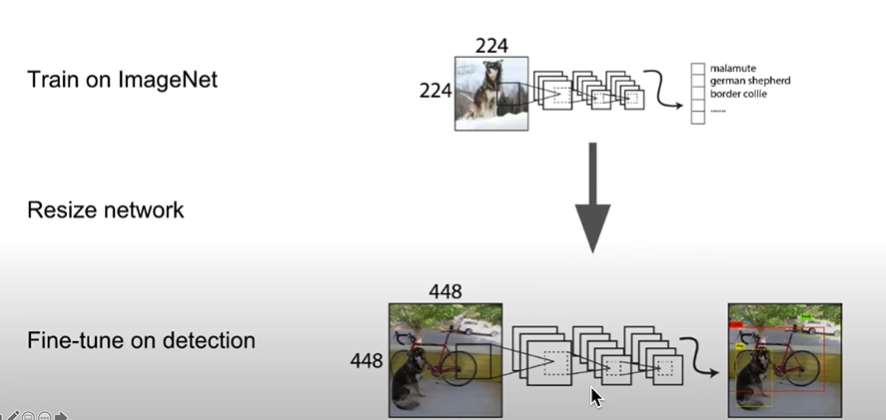

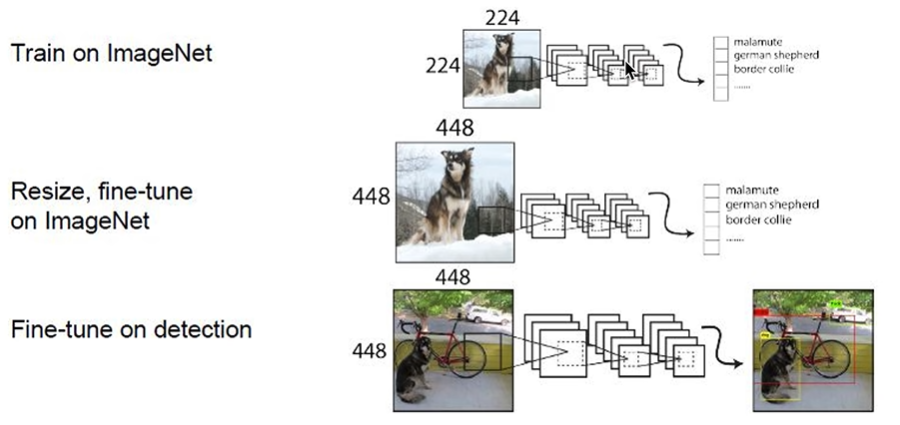

High Resloution Classifier

高分辨率分类器

YOLO v1骨干网络是在224×224图像上训练,再运用到448×448图像的检测。YOLO v2使用448×448图像进行训练。

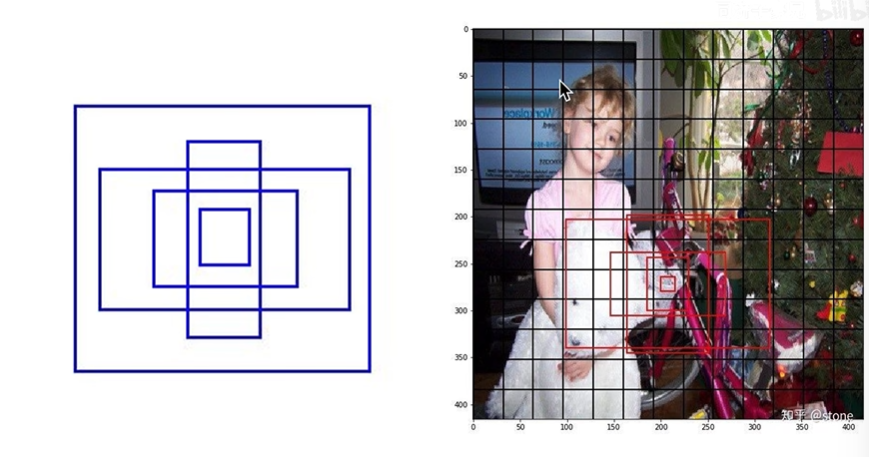

Anchor / Dimension Clusters / Direct location prediction

预设一组锚框(anchor boxes),使得不同大小的锚框负责预测不同尺寸的物体。

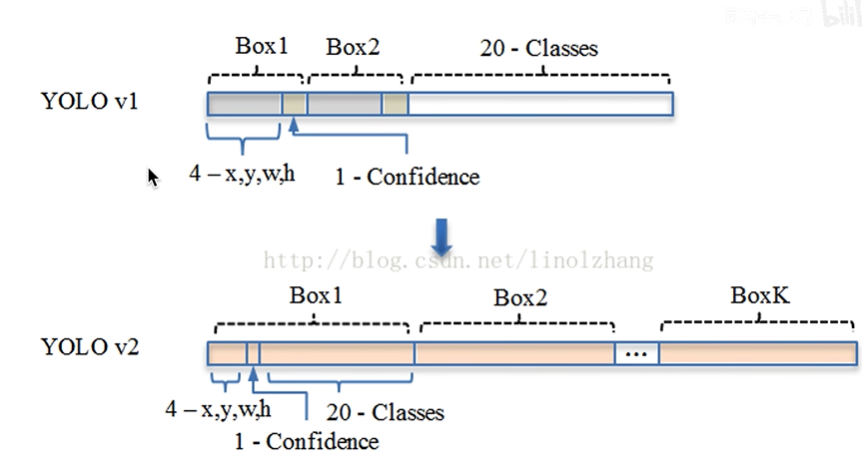

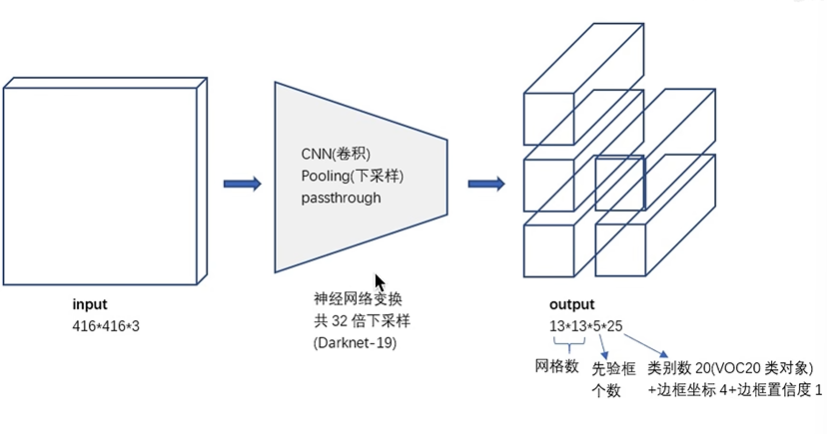

每个grid cell产生5个anchor,类别信息改为由anchor预测,每个anchor带有4个位置参数,一个置信度参数和20个类别参数。

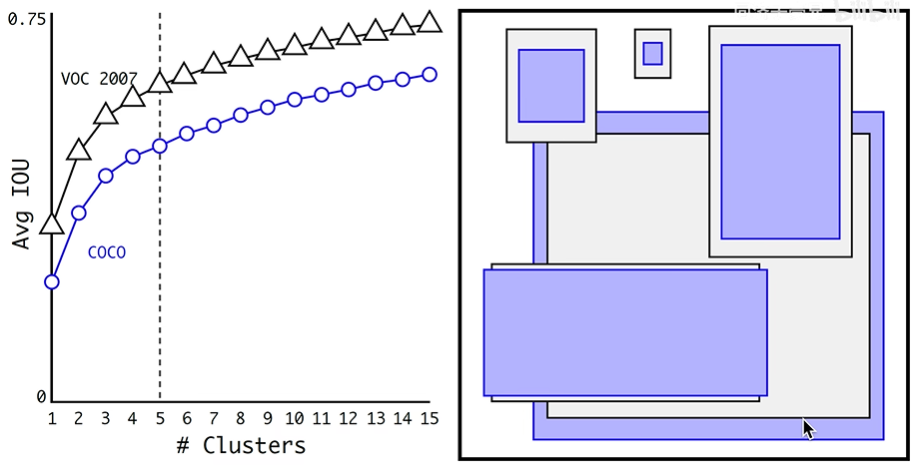

anchor的5个尺寸由对COCO和Pascal VOC数据集聚类得到。

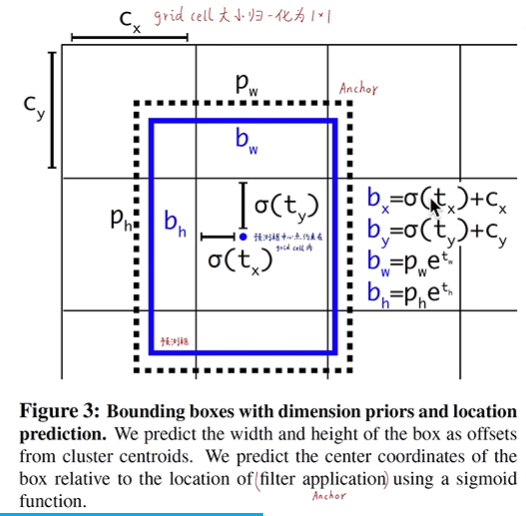

在anchor坐标回归上,添加sigmoid函数,将BB中心始终约束在grid cell内。

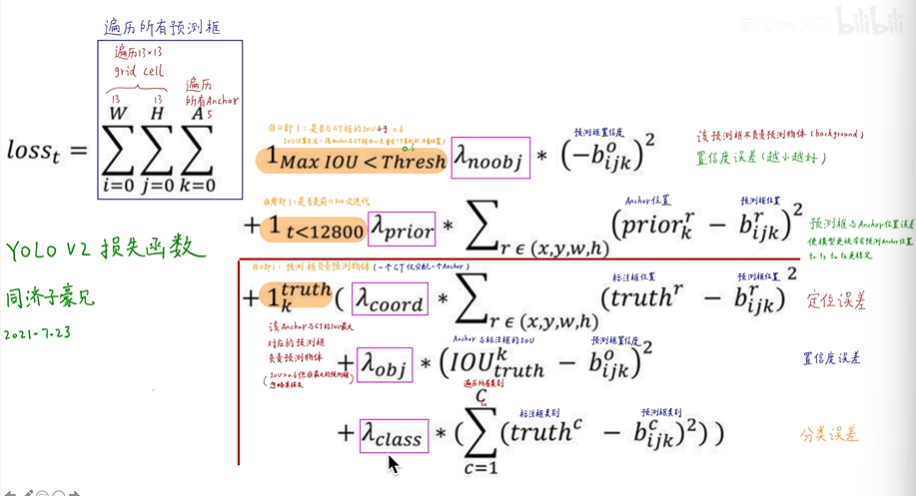

损失函数

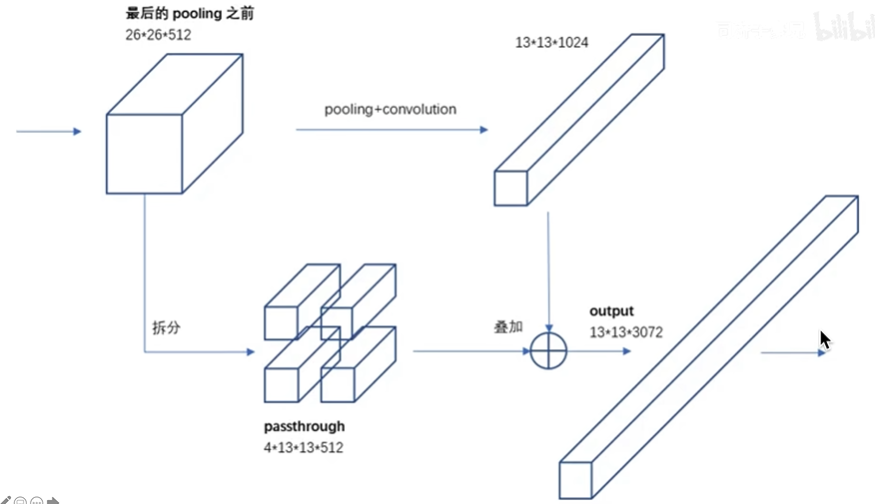

Fine-Grained Features

细粒度特征,把浅层网络的特征与深层网络特征叠加,整合不同尺度的特征。

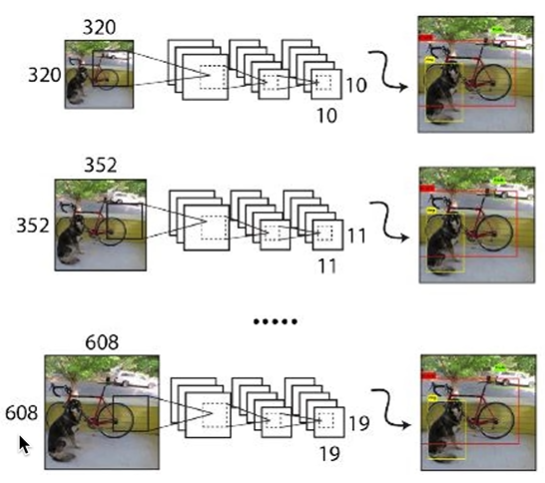

Multi-Scale Training

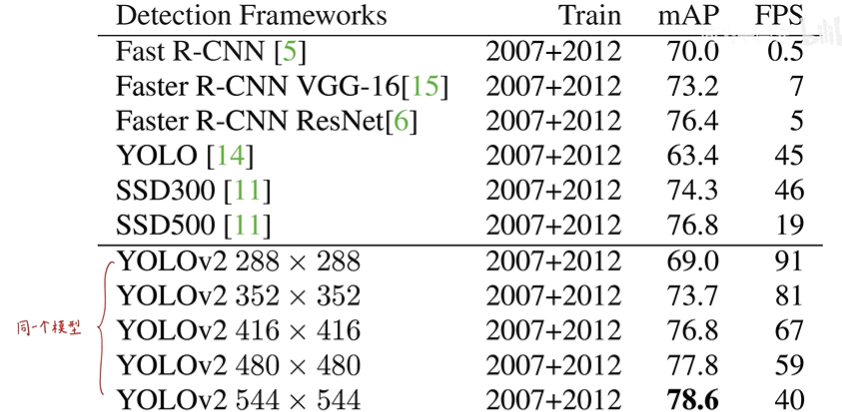

输入不同尺度的图像,迫使模型学习到不同尺度的特征。输入大尺度图像,模型速度变慢,精度提高。对于小尺度图片,速度变快,精度降低。

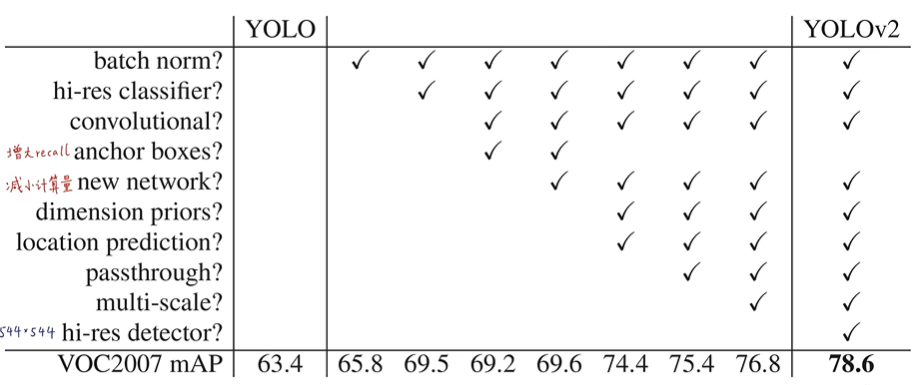

所有trick的提升

加入anchor虽然减小了mAP,但是recall大大提升。

Faster

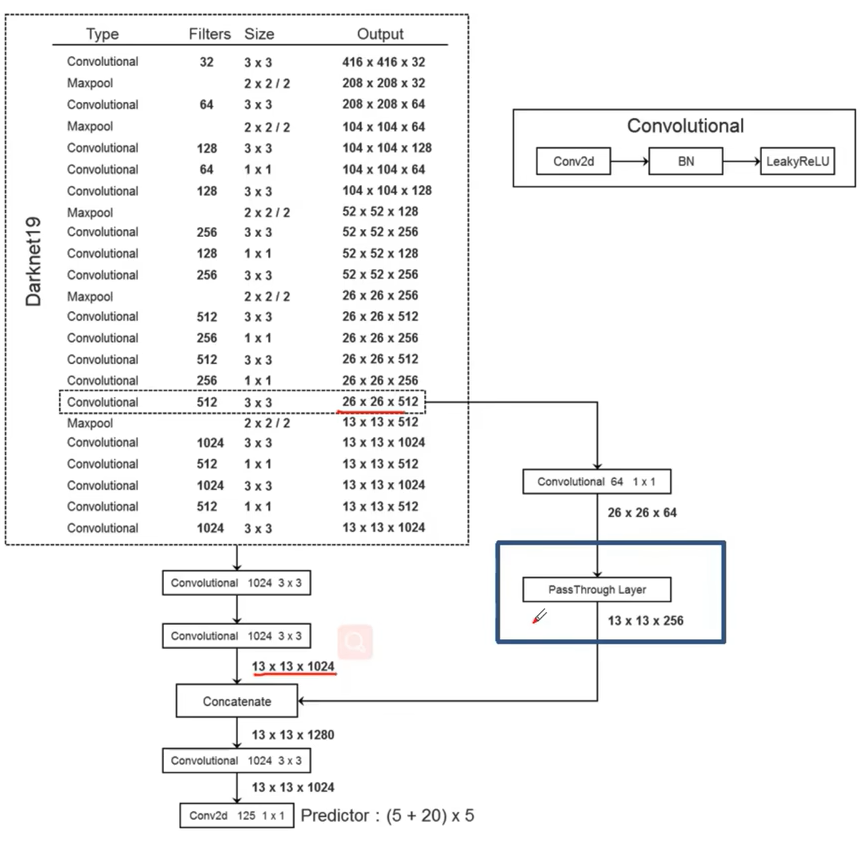

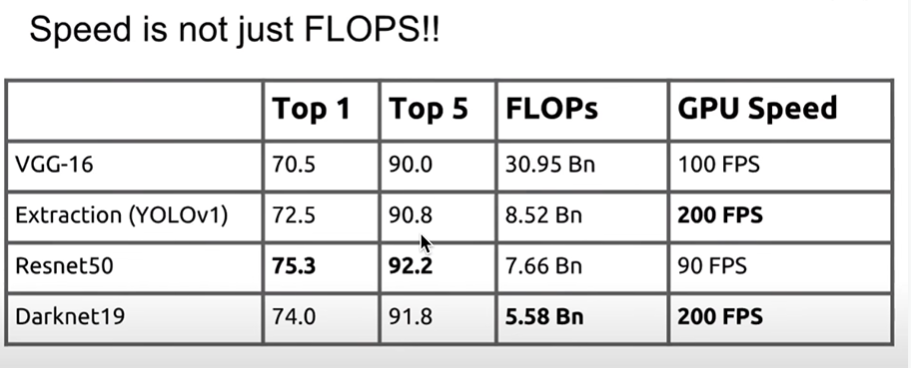

采用Darknet19作为骨干网络

整体结构:

Stronger

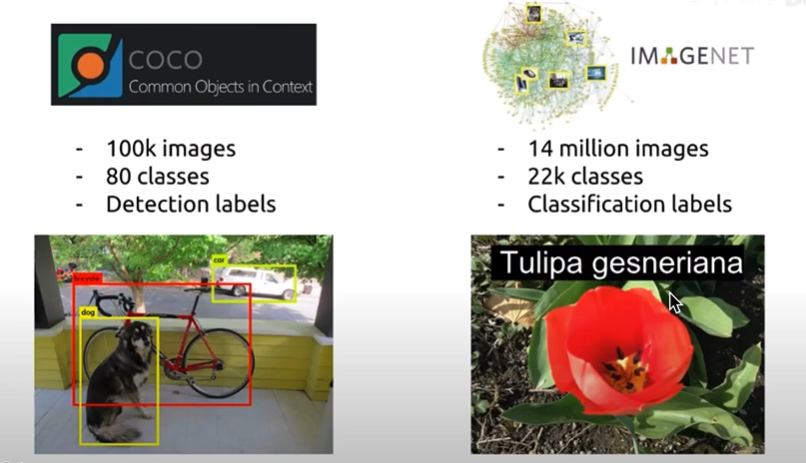

检测类别变得更多:将COCO目标检测数据集和Imagenet分类数据集联合训练。

Leeshy's Blog

Leeshy's Blog